准备模型

首先需要有MMD模型

这里在NicoNico3D上找了几个用做演示

(若解压乱码,用 “Bandzip” 打开然后点 “代码页->日语” 然后点 “解压” 就可以了)

(若解压乱码,用 “Bandzip” 打开然后点 “代码页->日语” 然后点 “解压” 就可以了)

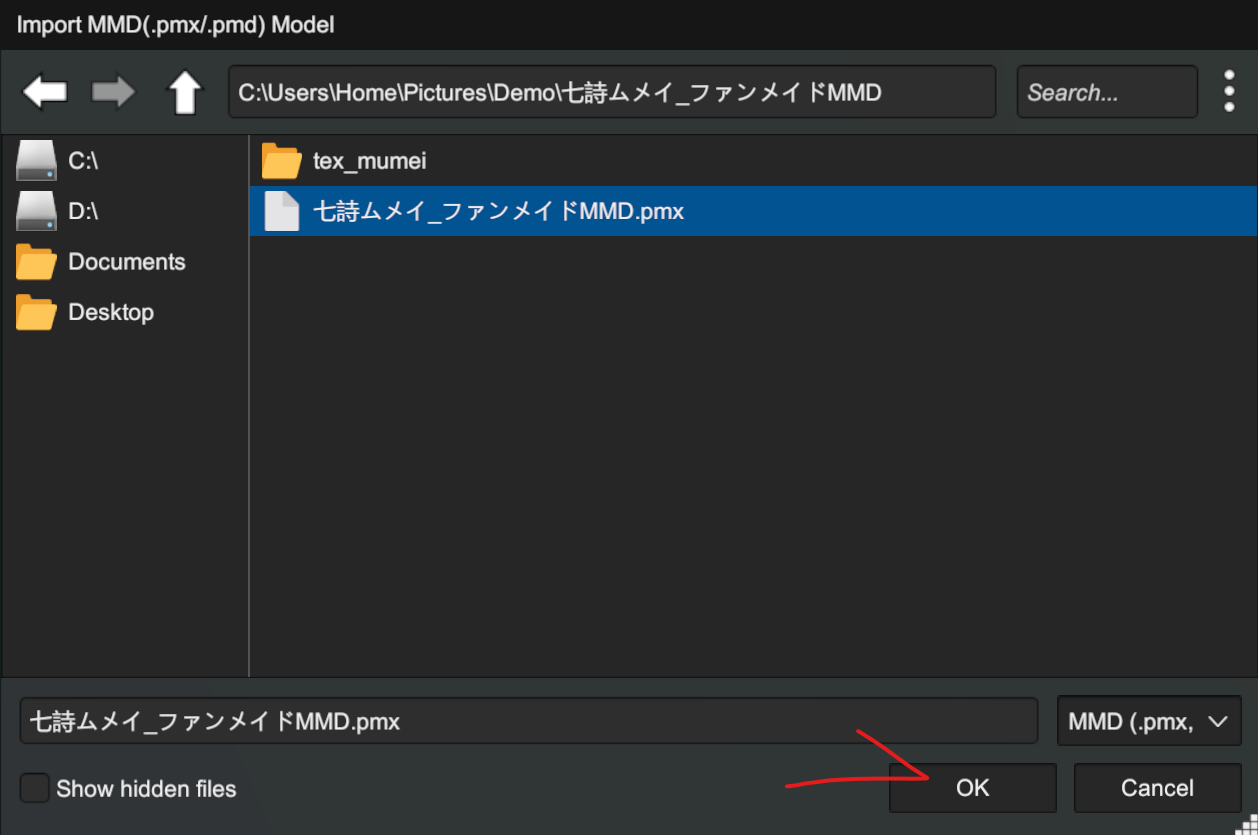

导入模型

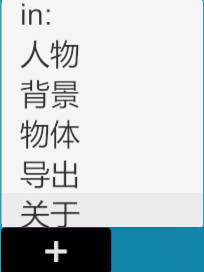

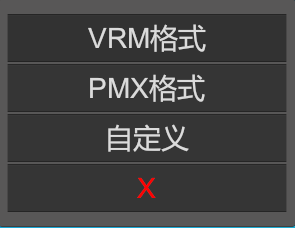

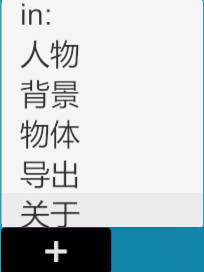

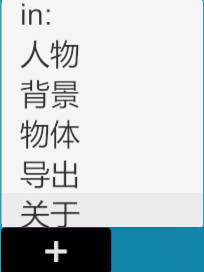

点击 “+” => 人物 => PMX模型 => RealToon模式

在弹出的窗口中选择pmx文件,点OK

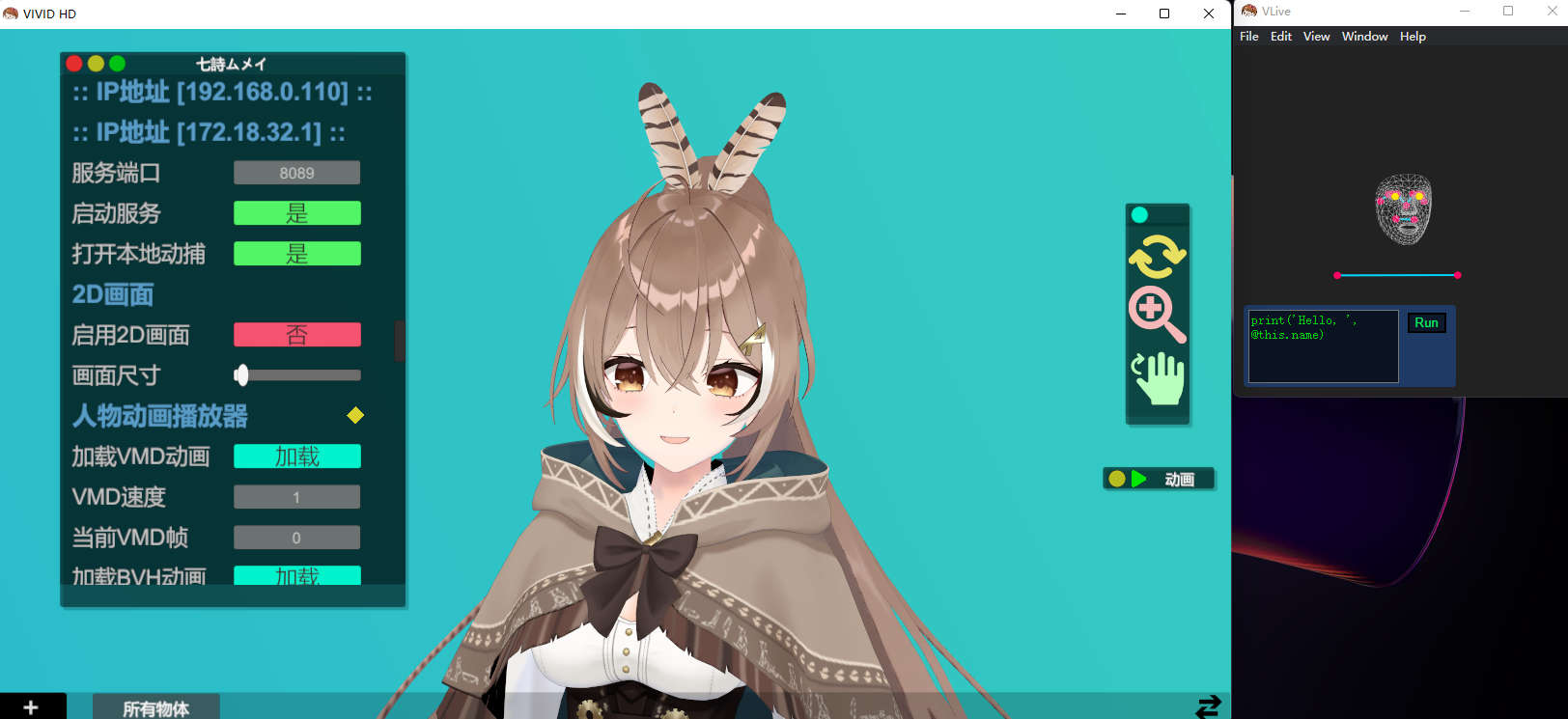

模型加载后,要调一下画面尺寸

在面板中找到 “2D画面” 下的 “画面尺寸”

这个值越低,2D感越强,反之3D感透视感越强,看模型需求

启动动捕

点 “动作捕获设置” 内的 “启动服务”,然后点 “打开本地动捕”

(不要让动捕程序最小化或被覆盖,细节见《完善直播功能》)

美化模型

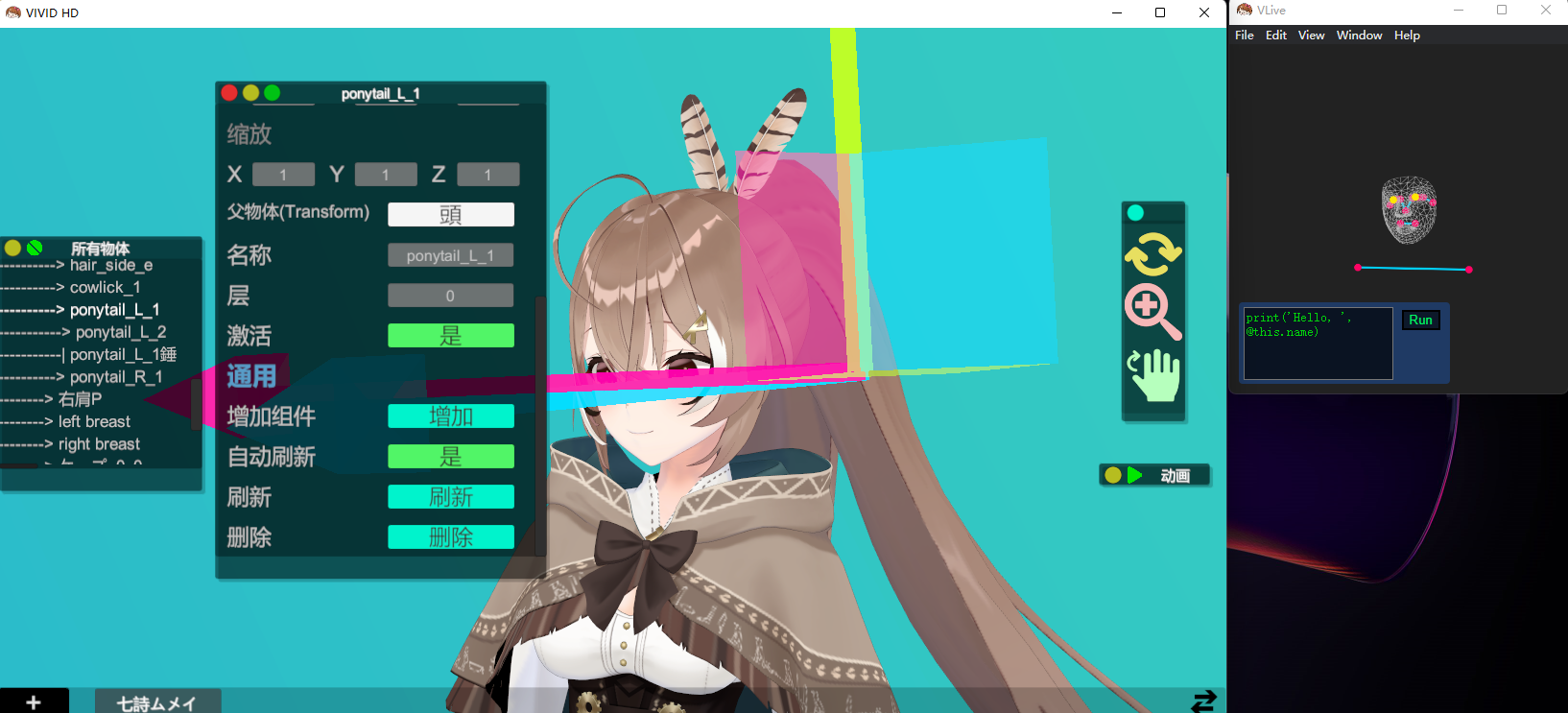

1.柔性骨骼

在 “所有物体” 窗口中展开模型的层级结构,找到负责柔性区域的骨骼

点击该骨骼面板底部的 “增加组件” 右边的 “增加”,选 “VSpringBone”

动起来是这样的

2.皮肤的动漫感

提升动漫角色的皮肤的饱和度,用来避免写实感(PBR低饱和写实感)

在子物体Root上加个 “VShaderUnit” 组件,目标材质选脸的材质

量要适当

3.固定手臂

把面板中的 “固定左手” 和 “固定右手” 右边的 “否” 点成”是”

效果

美化场景

1.气氛感

之前在 《几个内置效果》中提过全局雾,我们需要用遮盖关系营造气氛感

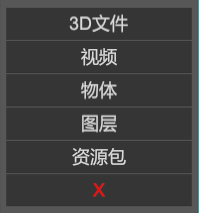

点 “+” => 物体 => 物体 => 光平面

调整位置,重点在人头上渐变光的位置

2.比例

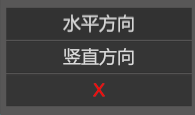

点击 “+” => 物体 => 图层 => 剪裁 => 水平方向

这个比例有剧场版的感觉

3.风格

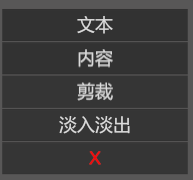

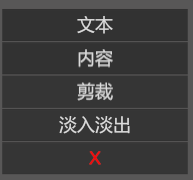

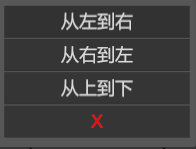

点击 “+” => 物体 => 图层 => 文本 => 从左到右

调整位置、大小以及字体

打开语音识别

再加两竖排翻译

(语音识别与翻译见《【新版本 1.0.1.1】语音识别与实时翻译》)

直播方式

1.推流直播

已经在 《完善直播功能》里讲过,类似软件操作同理

2.现场活动

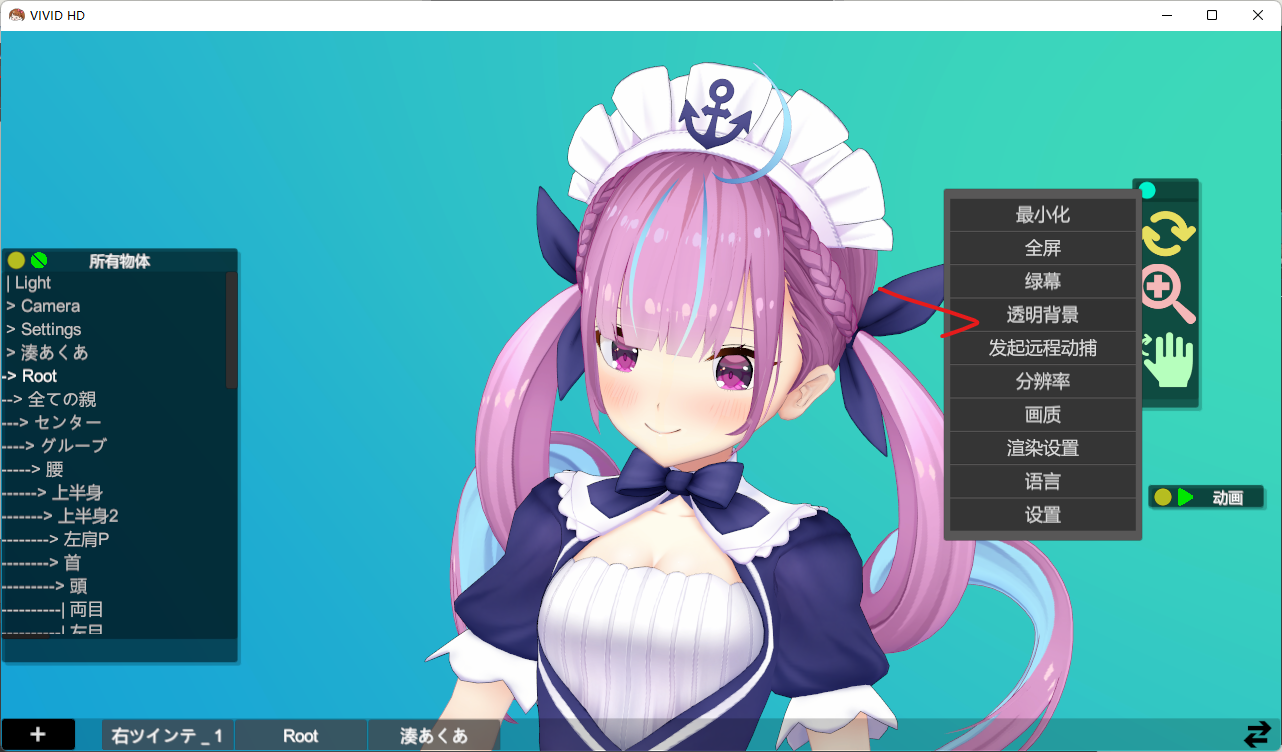

如果电脑直连大荧幕,就直接把主播合成到桌面上

F8切换 背景透明,F10切换 显示UI,F9切换 鼠标穿透

(详见《透明窗口和Windows融合》只适用Windows )

微调

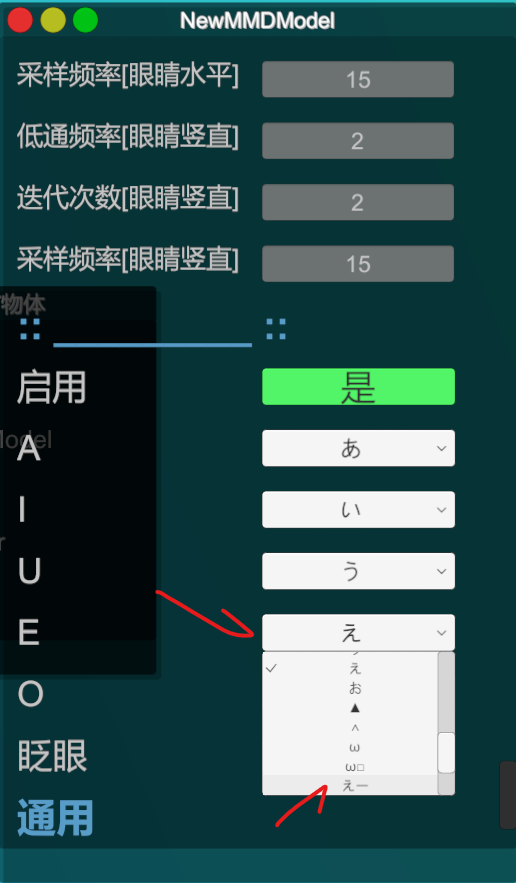

1.嘴部灵敏度

如果人说话模型嘴不动,调一下嘴部灵敏度看看,同时要减少嘴形最大值避免穿模

2.动作延迟

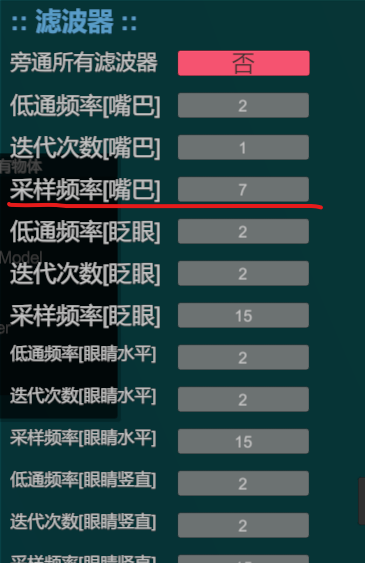

减少滤波器的采样频率可降低动作延迟,但会损失流畅感,多用在嘴部

3.开关描边

先找到对应的材质,然后在其面板内开关

VIVID也会自动检查、开关描边

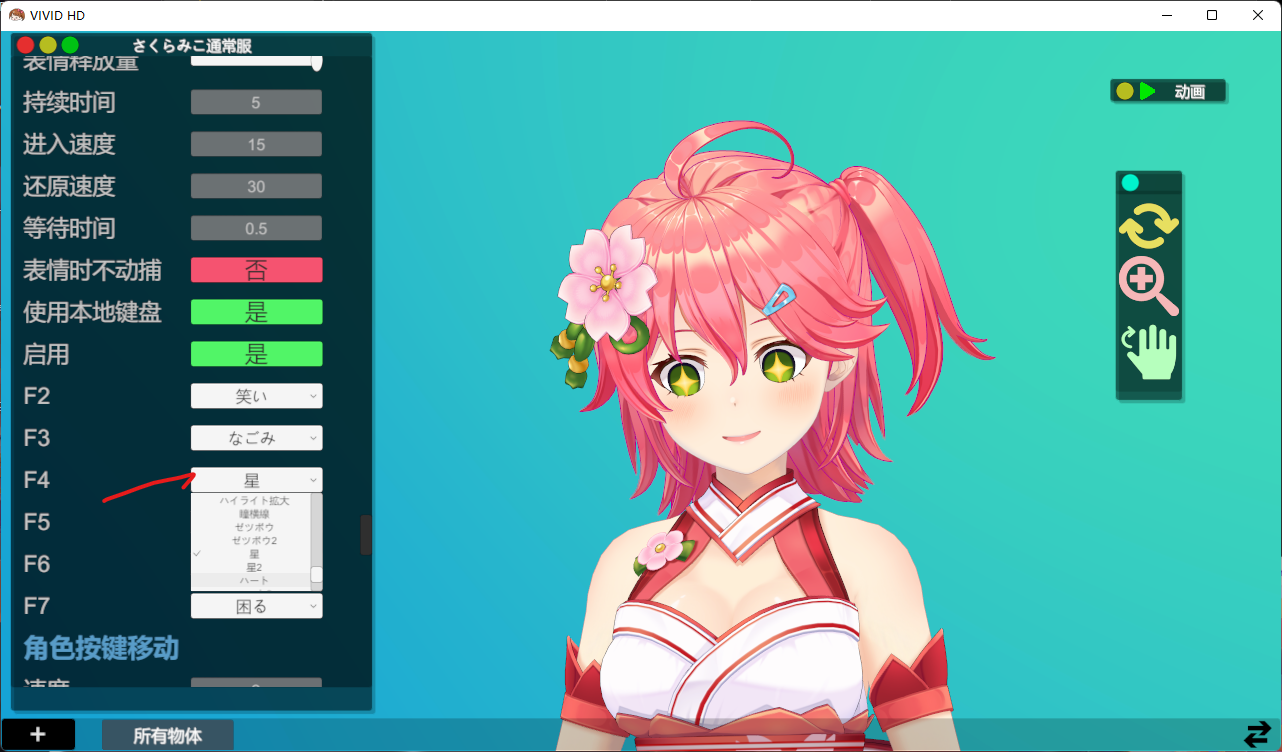

4.表情快捷键

F2到F7用来唤出模型包含的表情

你可以自定义快捷键唤出的表情

5.穿模控制

若遇到类似图中嘴和牙齿的穿模情况

可试着调节 “动捕:面部” 中 嘴型最大值 解决

也可以 设置不同信号对应的 模型表情 避免会穿模的表情

性能

VIVID使用分布式动捕将AI与渲染解耦,这种架构可以以较低的配置要求获得更高的FPS

(JS动捕端的低帧信号通过UDP传入VIVID端,在后者里经过滤波器与插值补帧到最终渲染)

(家用电脑跑出的FPS)

附录 – 模型著作信息

湊あくあ https://3d.nicovideo.jp/works/td63649

戌神ころね https://3d.nicovideo.jp/works/td63650

さくらみこ https://3d.nicovideo.jp/works/td74928

七詩ムメイ https://3d.nicovideo.jp/works/td84230

がうる·ぐら 新衣装 https://3d.nicovideo.jp/works/td83492

たわ式ラプラス·ダークネス https://3d.nicovideo.jp/works/td83872

🙂